HiDataPLus(HDP)332上手工集成安装

HiDataPLus(HDP)3.3.2.*公开发布版没有集成HivePlus的Stack,需要手工部署Ambari Stack和更新HDP-UTITS安装源。

1. 安装集群

可以参考HDP332安装部署,需要相关组件:

- HDFS 必需

- YARN 必需

- HIVE 必需

- Ranger 可选

2. Ambari Server上部署Stack

(1) 下载Stack更新包

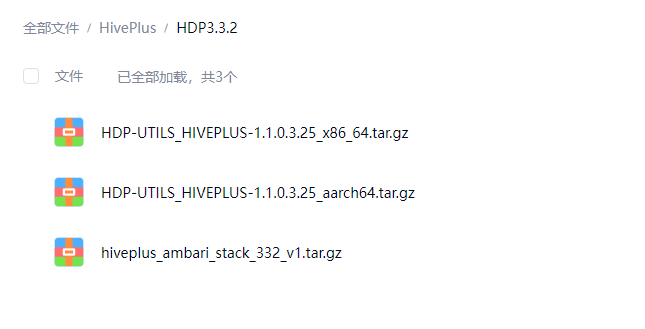

在百度网盘下载 HDP3.3.2目录 hiveplus_ambari_stack_332_v*.tar.gz,版本越新越好。

(2) 上传到Ambari Server所在服务器

下文以hiveplus_ambari_stack_332_v1.tar.gz,放到ambari server所在机器的 /app/ 目录。

(3) 解压

cd /app/

tar zxvf hiveplus_ambari_stack_332_v*.tar.gz

ls -l hiveplus_ambari_stack_332

(4) 更新文件

#清理,如有自定义,请另行备份。

rm -fr /var/lib/ambari-server/resources/stacks/HDP/3.3/services/OPENJDK17

rm -fr /var/lib/ambari-server/resources/stacks/HDP/3.3/services/HIVEPLUS

#更新

/bin/cp/dfr -fr /app/hiveplus_ambari_stack_332/* /var/lib/ambari-server/resources/stacks/HDP/3.3/services/

(5) 重启Ambari Server

ambari-server restart

部署Stack将会新增OPENJDK和HIVEPLUS两个文件夹的文件,不会影响其他组件,可以放心使用。

3. 更新HDP-UTILS包安装源文件

为避免压缩包过大,OpenJDK17和HivePlus的安装文件放置在HDP-UTILS安装源里,可以直接将原有文件删除后替换。

(1) 下载RPM或Deb安装压缩包。

在百度网盘 的 HDP3.3.2目录下载对应操作系统类型和CPU架构的HDP-UTILS_HIVEPLUS-1.1.0.3.25_***.tar

(2) 上传到HDP-UTILS安装源所在服务器

下文以HDP-UTILS_HIVEPLUS-1.1.0.3.25_x86_64.tar.gz,放到HDP-UTILS安装源所在服务器所在机器的安装源根目录,假定目录为/app/repo/, /app/repo/1.1.0.22 为原有的HDP-UTILS目录。

|--安装根目录 根目录

|--1.1.0.22 旧目录

|--HIVEPLUS-1.1.0.3.25 新目录

(3) 解压

cd /app/repo/

tar zxvf HDP-UTILS_HIVEPLUS-1.1.0.3.25_x86_64.tar.gz

(4) 删除或者备份原有文件,将解压文件覆盖

#备份原有目录

mv 1.1.0.22 1.1.0.22_bake

#用新文件替换

mv HIVEPLUS-1.1.0.3.25 1.1.0.22

4. 更新集群节点的Cache

在以前安装Rpm或者Deb过程,会产生缓存,如果安装过程因缓存引起问题,可以参照进行清理。

- RPM相关操作系统

#清理所有缓存,谨慎使用

yum clean all

- Deb相关操作系统

#清理所有缓存,谨慎使用

rm -fr /var/lib/apt/lists/*

apt clean

apt update

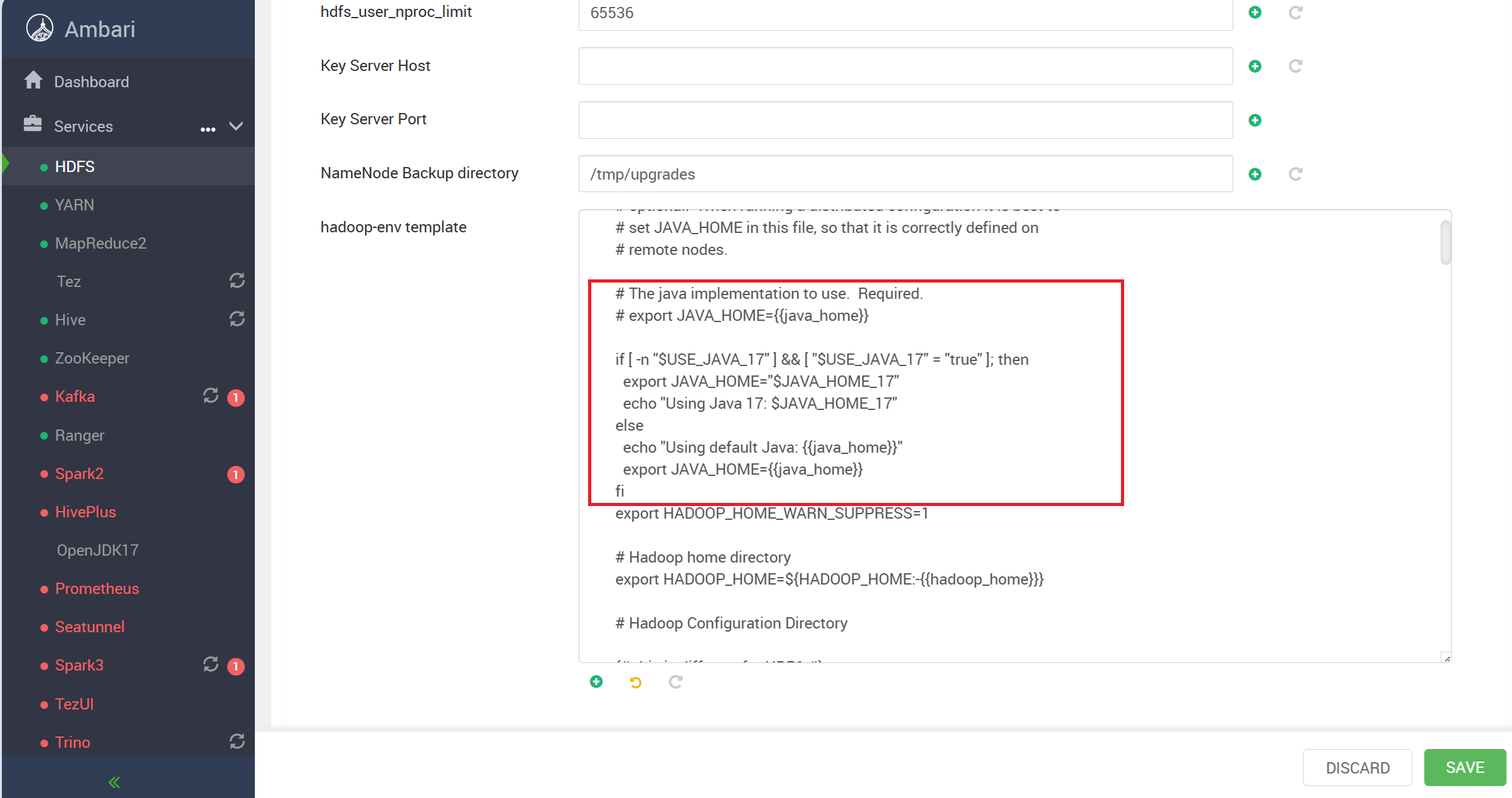

6. 调整Hadoop-env.sh

由于HivePlus使用JDK17,所以需要调整Hadoop-env.sh的JAVA_HOME配置。调整后不影响之前的服务。相关代码如下:

# The java implementation to use. Required.

# export JAVA_HOME={{java_home}}

if [ -n "$USE_JAVA_17" ] && [ "$USE_JAVA_17" = "true" ]; then

export JAVA_HOME="$JAVA_HOME_17"

echo "Using Java 17: $JAVA_HOME_17"

else

echo "Using default Java: {{java_home}}"

export JAVA_HOME={{java_home}}

fi

相关参数需要在Ambari界面进行进行调整,调整后需要重启HDFS服务。

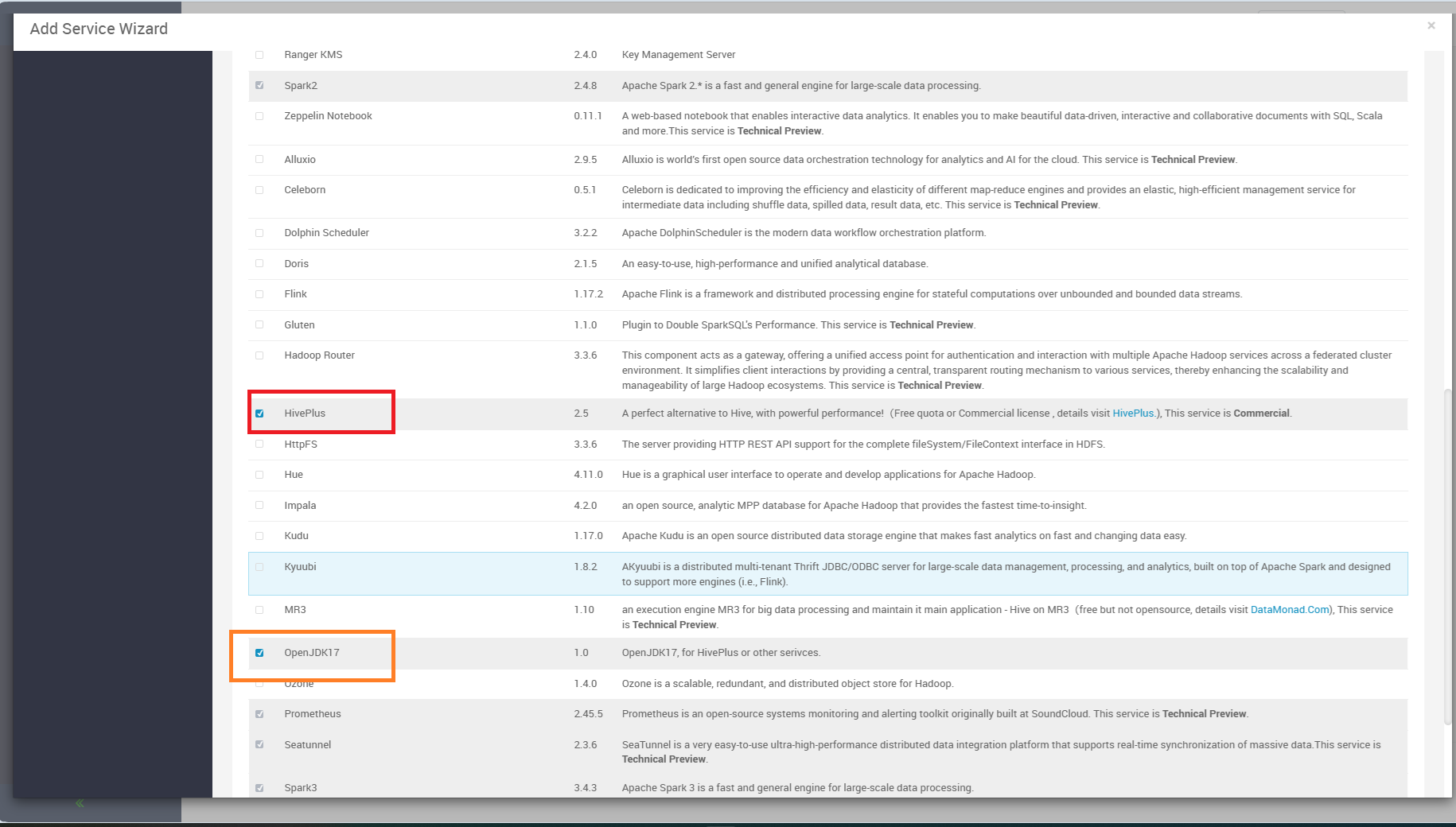

5. 安装HivePlus

在Ambari界面进行安装

(1) 新增服务

涉及两个服务:

- OPENJDK17: 默认集成了OPENJDK17方便使用,如果有偏好版本,可以不安装此服务,另行安装。

- HivePLus: 主要服务,必须安装。

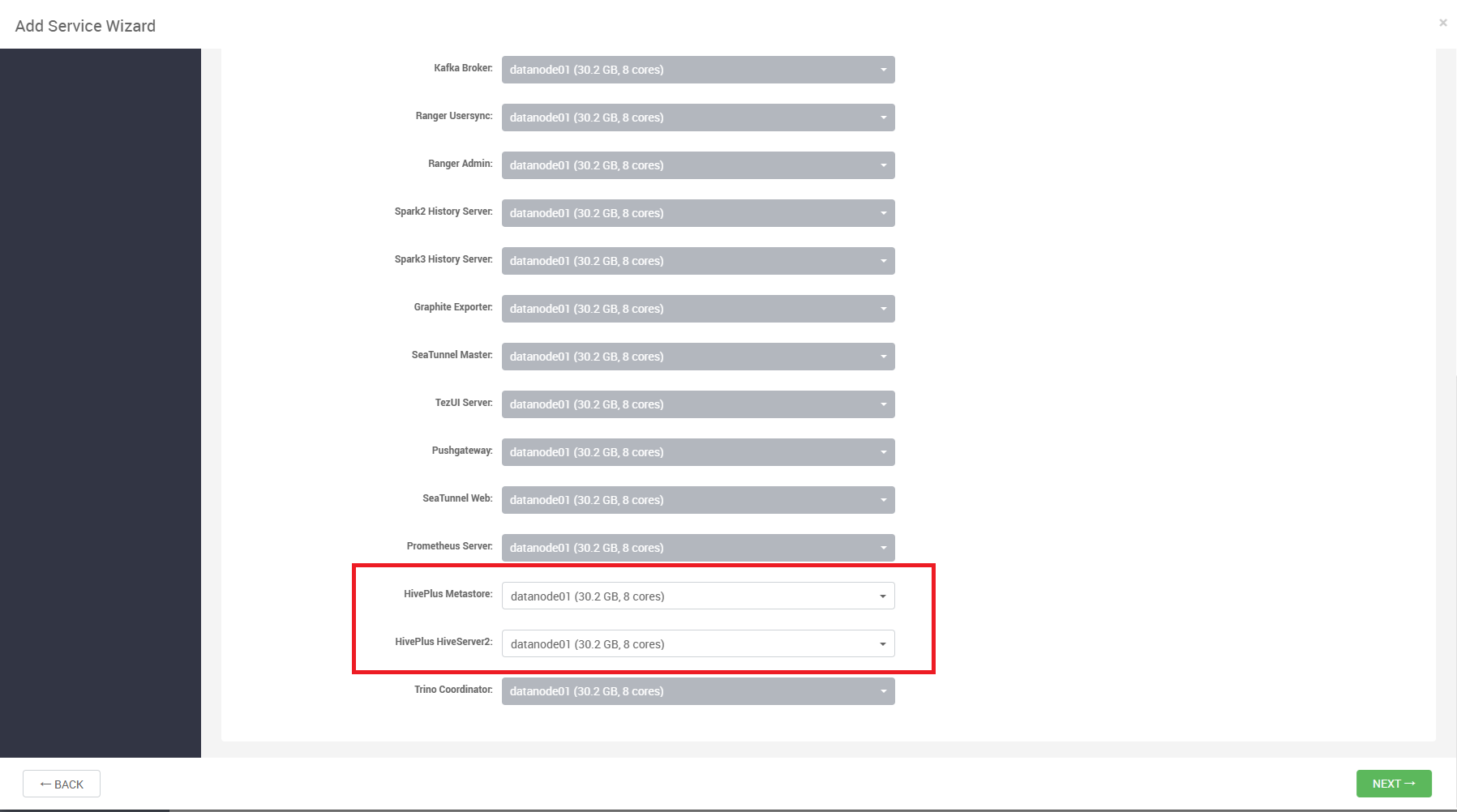

(2) 分配安装节点-主服务

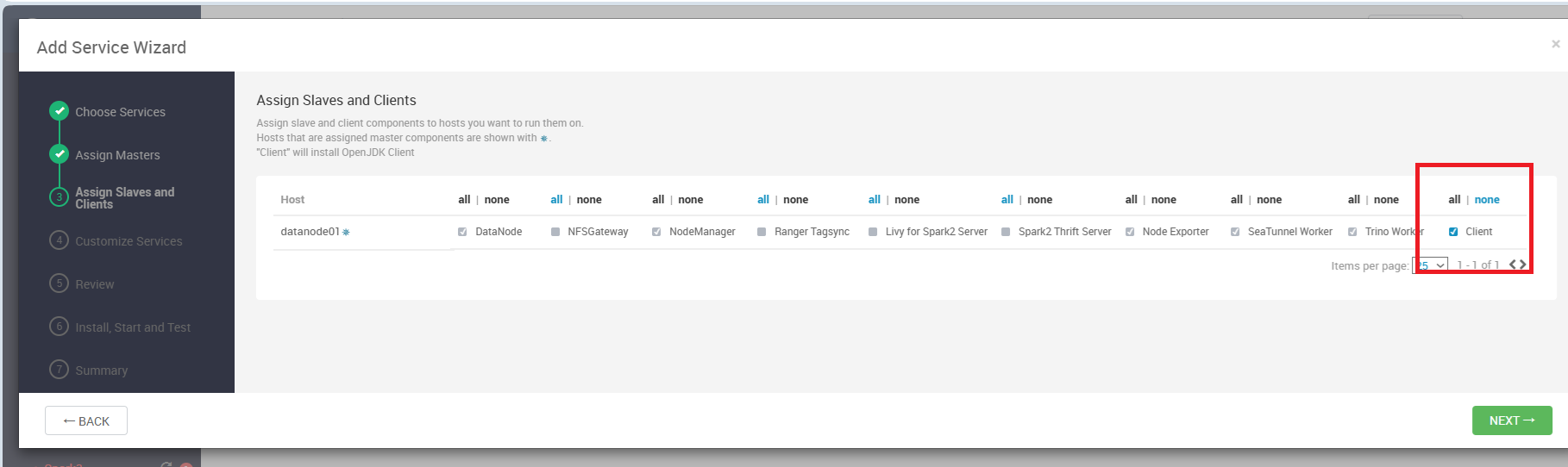

(3) 分配安装节点-客户端

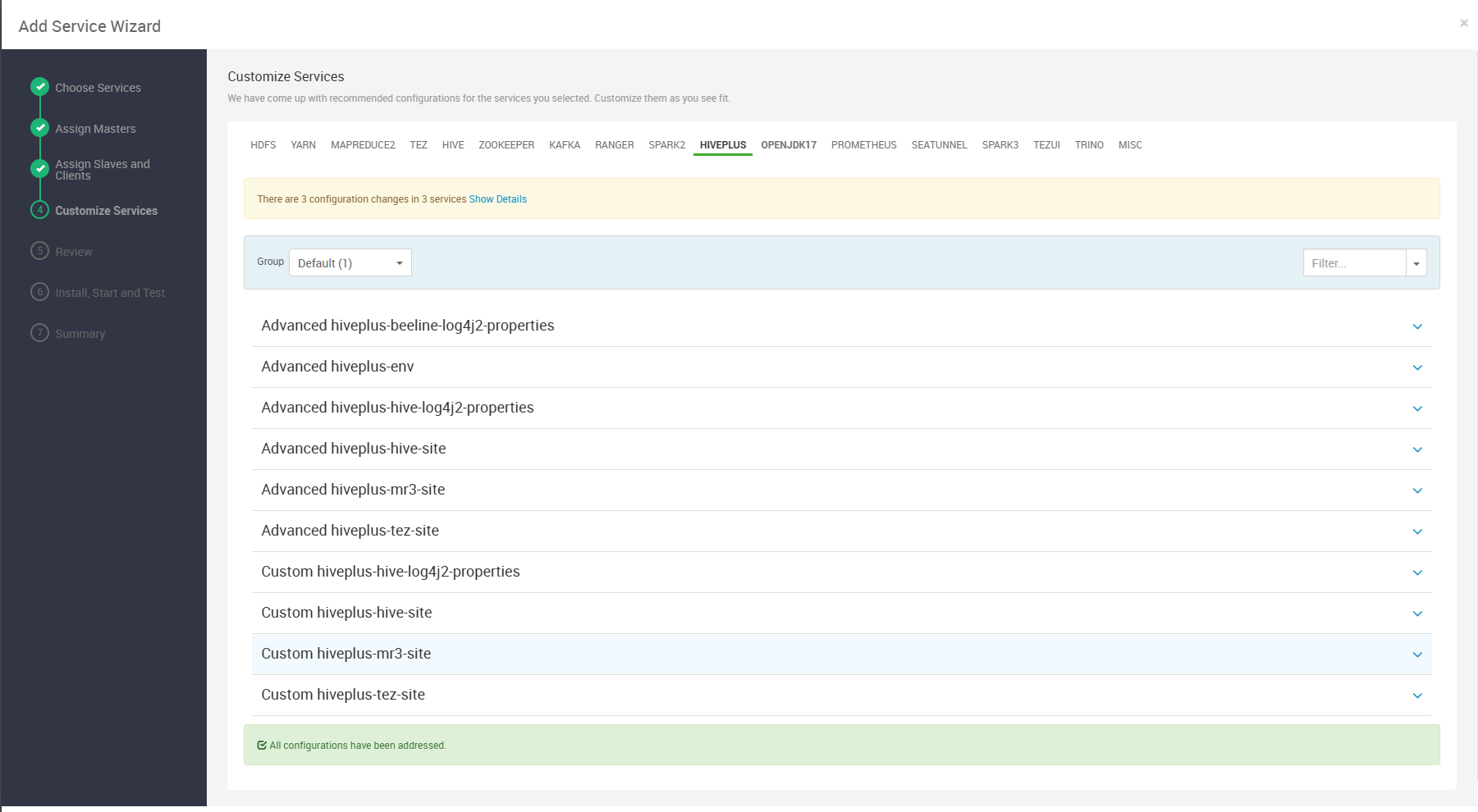

(4) 参数配置

一般情况下,不需要调整,或者安装后调整。

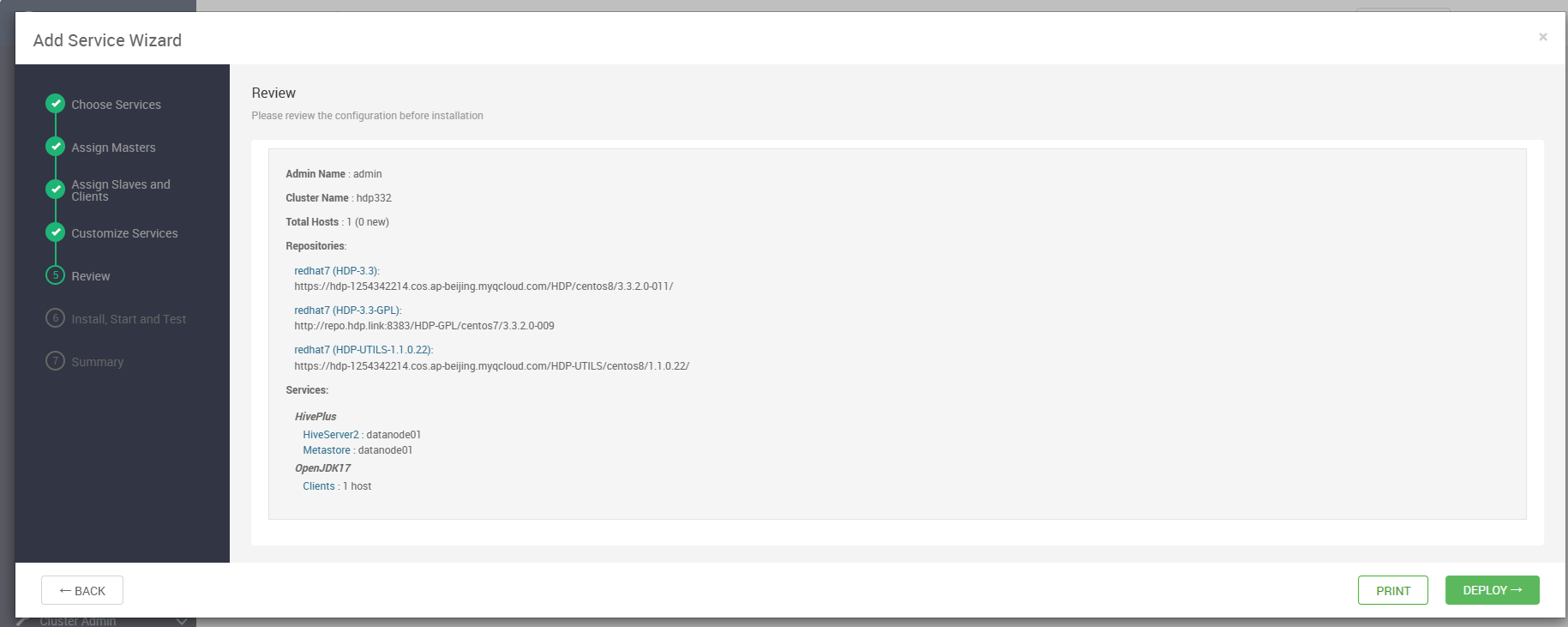

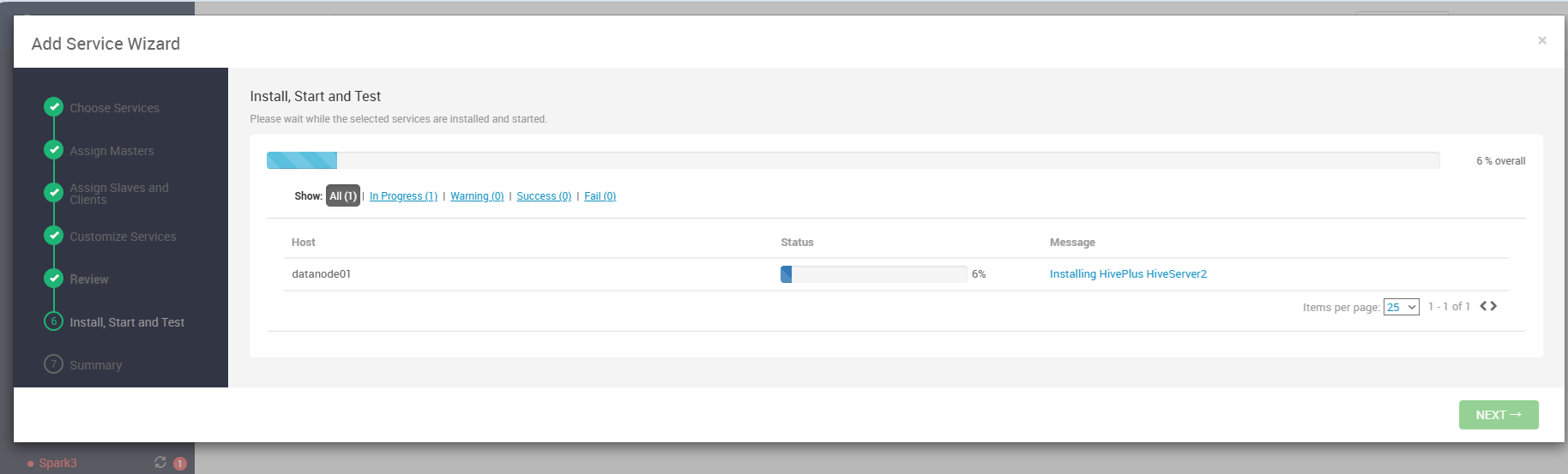

(5) 执行部署

执行中,需要几分钟。

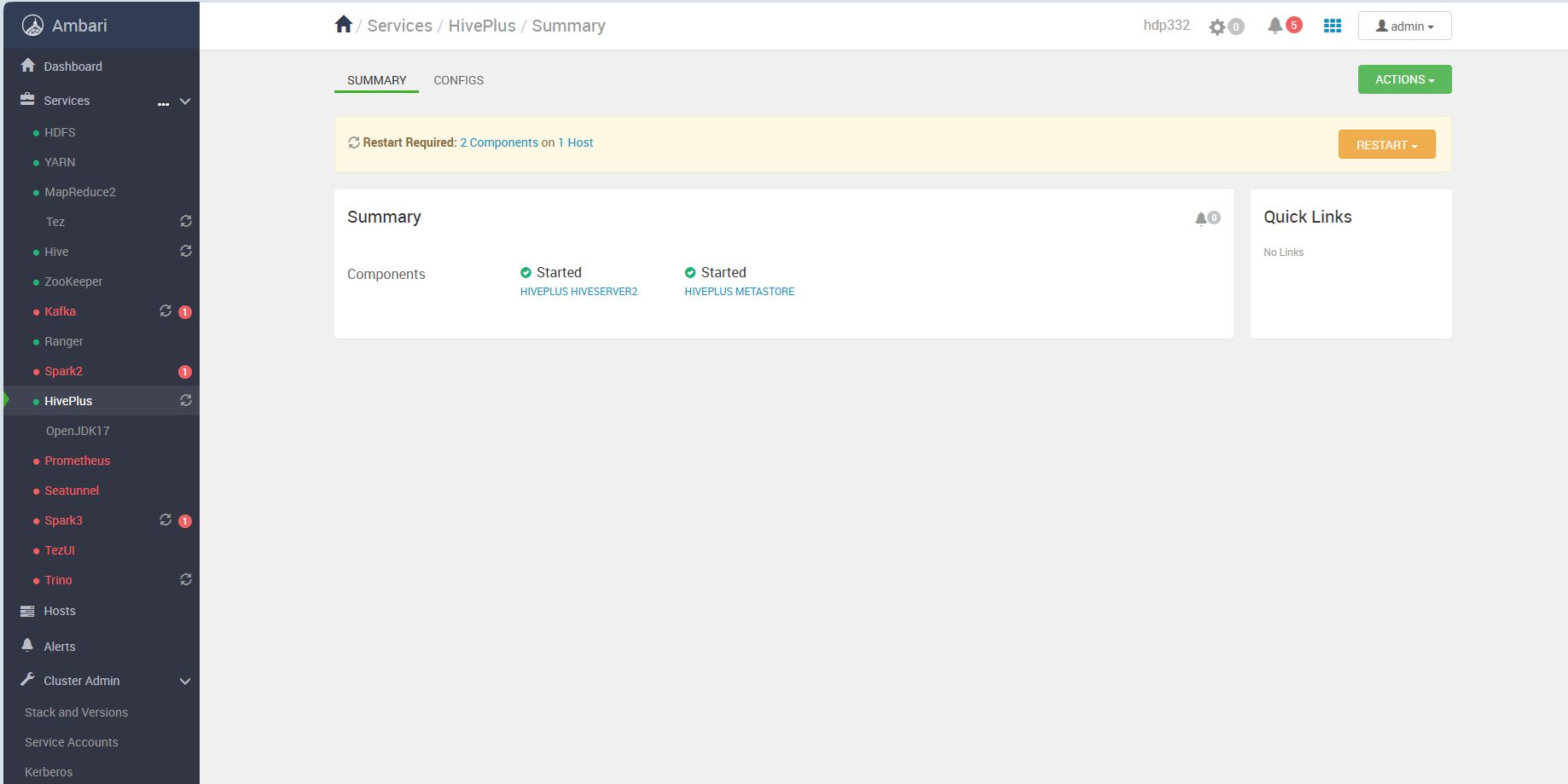

(6) 部署完成后自动启动服务。

部署完成,服务自动启动,如果遇到问题,根据问题描述进行解决。

默认安装使用Hive的Metastore,可能存在SQL统计信息不准确导致的SQL执行计划不佳,可以尝试启用HivePlus Metastore。

6. 执行SQL验证

参考使用方式